Tous les projets

juillet 2025

Spellmotion

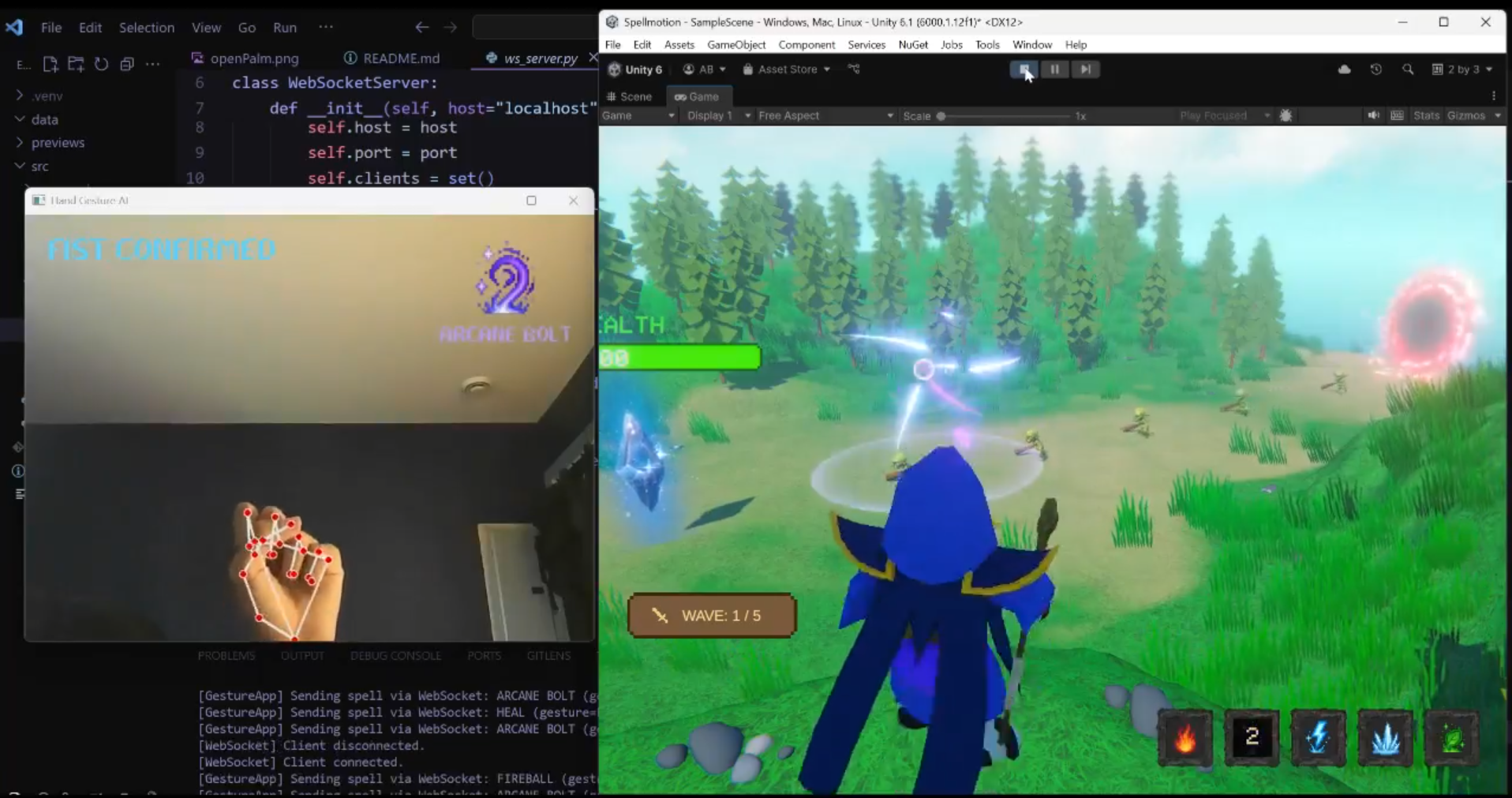

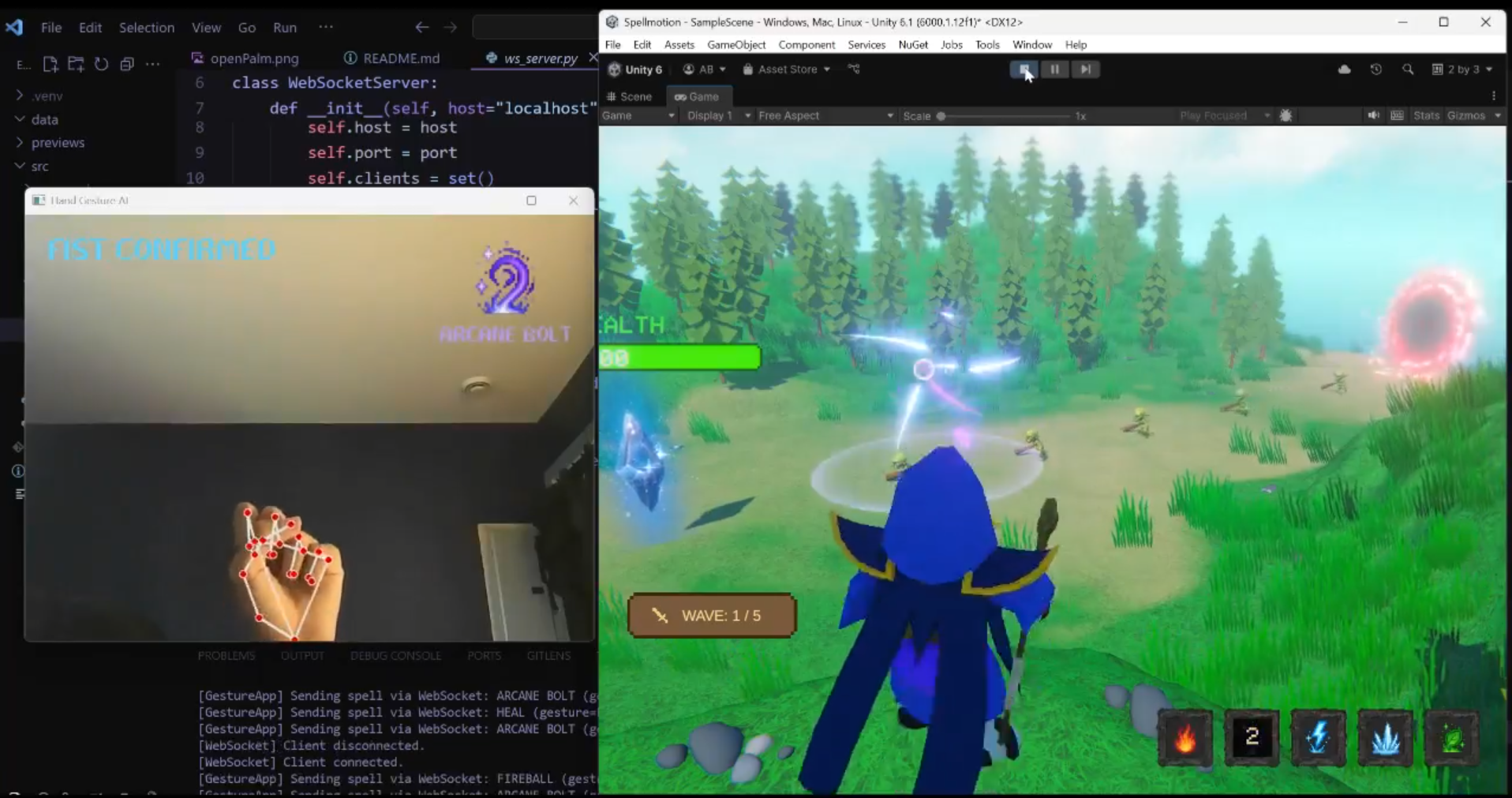

J'ai entrepris ce projet en solo avec la volonté d'explorer le domaine de la vision par ordinateur à travers une application concrète. Passionné par le développement, j'ai eu l'idée de fusionner cette technologie avec la création de jeux vidéo pour concevoir une expérience immersive où les commandes physiques traditionnelles sont remplacées par des interactions naturelles. L'objectif était de transformer des concepts théoriques de traitement d'image en un outil de contrôle intuitif et réactif pour un environnement virtuel.

Ma contribution

En tant que concepteur unique, j'ai développé l'intégralité de l'écosystème en commençant par une application Python dédiée à l'intelligence artificielle. J'ai utilisé MediaPipe et OpenCV pour détecter les points de repère de la main et j'ai conçu des algorithmes de classification capables de traduire des gestes spécifiques en commandes de sorts. Pour la partie ludique, j'ai bâti sous Unity un jeu de défense complet incluant la logique de combat, les systèmes de particules pour les effets magiques et la gestion des vagues d'ennemis. J'ai également assuré la synchronisation entre ces deux univers en mettant en place une communication bidirectionnelle par WebSockets, permettant une transmission quasi instantanée des données JSON pour garantir la fluidité du gameplay.

Project Gallery

Visual Overview

Approche

Ma stratégie a reposé sur une architecture découplée afin de maximiser les performances de chaque composant. J'ai séparé le traitement lourd de la vision par ordinateur, géré par le script Python, du rendu graphique pris en charge par le moteur Unity. Cette approche modulaire m'a permis d'isoler et d'affiner la précision de la détection gestuelle indépendamment du moteur de jeu. Pour lier l'ensemble, j'ai choisi le protocole WebSocket en local, ce qui offre une latence minimale indispensable à la sensation de contrôle en temps réel, transformant ainsi une simple webcam en un périphérique de jeu sophistiqué.

Fonctionnalités

- Reconnaissance gestuelle IA

- Communication WebSocket temps réel

- Moteur de jeu Unity

- Système de sorts variés

- Effets visuels (VFX)

- Gestion de vagues d'ennemis

More Projects